魔搭社区+OpenVINO™ 加速部署 Qwen3-ASR 实战

继 魔搭社区+OpenVINO™ 加速部署 Qwen3-TTS 实战 后,紧锣密鼓安排上Qwen3-ASR 的实战教程。

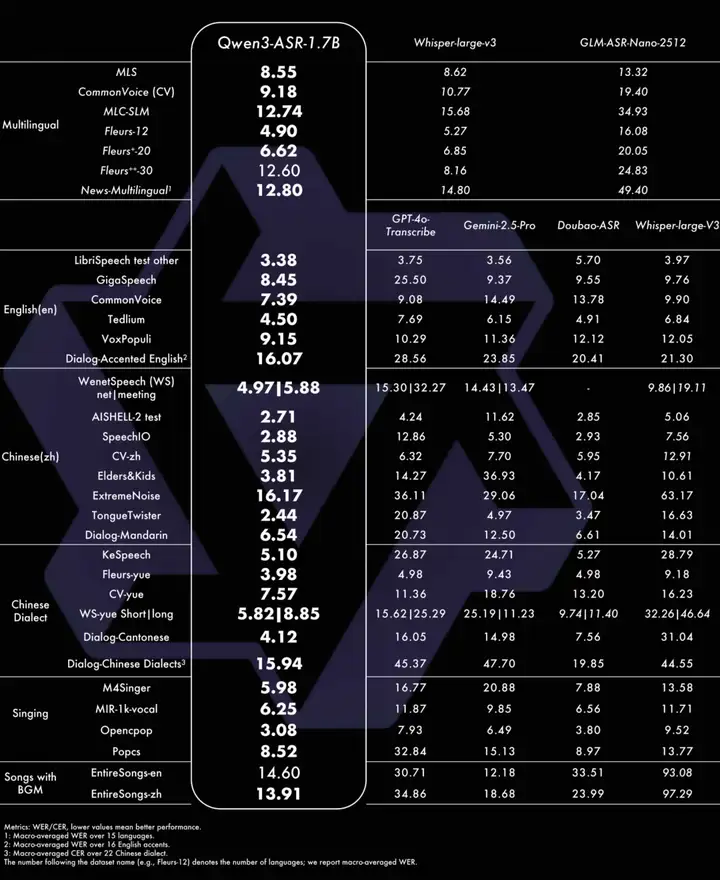

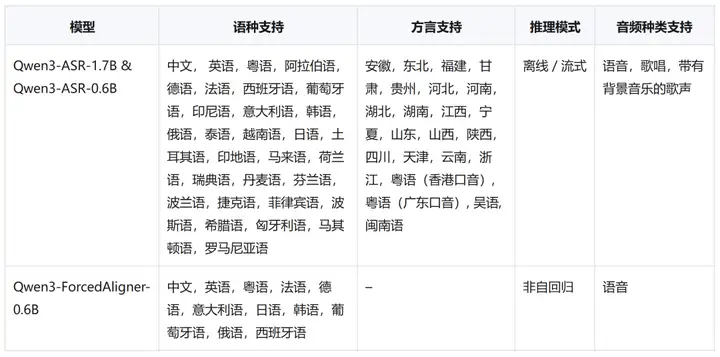

Qwen3-ASR 系列模型也是通义千问团队在春节前发布的音频理解方向最新成果 ,包含 1.7B 和 0.6B 两个版本。作为 Qwen 语音家族的最新成员,它在多语言识别和处理复杂声学环境方面展现了卓越的性能。

开源资源:

- Qwen3-ASR官方仓库: https://github.com/QwenLM/Qwen3-ASR

- 魔搭社区地址:https://modelscope.cn/collections/Qwen/Qwen3-ASR

- OpenVINO™官方文档: https://docs.openvino.ai/

- Notebooks: https://modelscope.cn/gallery/Cherrytest/31572716-e08a-47b8-bf58-e3f81dd63f41

- Qwen3-ASR技术论文: https://modelscope.cn/papers/2601.21337

模型特性

- All-in-one(全能型):支持52 种语言和方言的语种识别(LID)与自动语音识别(ASR),包括 30 种语言、22 种中国方言以及来自多个国家和地区的英语口音。

- Excellent and Fast(卓越且高效):在复杂声学环境和挑战性文本模式下保持高鲁棒性。1.7B 版本在开源 ASR 模型中达到了 SOTA 水平;而 0.6B 版本在保证精度的同时,在 128 并发下实现了2000 倍吞吐量,支持流式与离线统一推理及长音频转写。

- 核心优势:利用大规模语音训练数据和 Qwen3-Omni 基础模型的强大音频理解能力,在多项公开和内部基准测试中表现强劲。

模型部署实战

魔搭社区和 Intel® OpenVINO™ 工具套件合作,通过原生转换方式在 Intel 平台上实现 Qwen3-ASR 的极致加速。

第一步:环境准备

为了确保与 Qwen3-ASR 架构兼容,我们需要安装特定版本的依赖库并克隆官方仓库。

# 1. 基础环境安装(要求 OpenVINO >= 2025.4)

pip install "openvino>=2025.4.0"

pip install "gradio>=4.0"

pip install qwen-asr

# 2. 克隆并安装 Qwen3-ASR 官方代码库

git clone https://github.com/QwenLM/Qwen3-ASR.git

cd Qwen3-ASR

pip install -e .

cd ..

# 3. 安装OpenVINO相关依赖

!git clone https://github.com/openvino-dev-samples/openvino_notebooks.git

%cd openvino_notebooks

!git checkout 69b0f57

第二步:模型下载与转换

OpenVINO™ IR (Intermediate Representation)是OpenVINO™的中间表示格式,针对推理进行了深度优化。Qwen3-ASR模型包含4个子模块,需要分别转换:

1. Audio Conv Model (openvino_thinker_audio_model.xml): 音频特征提取的Conv2D前端

2. Audio Encoder Model (openvino_thinker_audio_encoder_model.xml): Transformer编码器层

3. Embedding Model (openvino_thinker_embedding_model.xml): 文本token嵌入层

4. Language Model (openvino_thinker_language_model.xml): 主LLM解码器,支持KV-cache

模型下载

下载命令:

modelscope download --model Qwen/Qwen3-ASR-0.6B

使用OpenVINO提供的helper函数进行转换:

from pathlib import Path

from qwen_3_asr_helper import convert_qwen3_asr_model

# 配置参数

model_id = "Your_PATH/Qwen3-ASR-0.6B"

model_name = model_id.split("/")[-1]

ov_model_dir = Path(f"{model_name}-OV")

# 执行转换:将 PyTorch 模型导出为 OpenVINO IR 格式

# 如果需要量化,可以在 quantization_config 中配置 NNCF 参数

print(f"🚀 正在转换 Qwen3-ASR 模型...")

convert_qwen3_asr_model(

model_id=model_id,

output_dir=ov_model_dir,

quantization_config=None

)

print(f"✅ 转换完成,模型保存至: {ov_model_dir}")

也可以将model_id通过以下方式替换成原始模型的本地路径进行转换:

convert_qwen3_asr_model(

model_id=local_model_dir,

output_dir=ov_model_dir,

quantization_config=None, # 可选:设置 NNCF 配置进行 INT8 量化

use_local_dir=True,# 可选:设置使用本地模型

)

第三步:模型部署与推理

在部署阶段,使用 OVQwen3ASRModel 加载转换后的组件。该类封装了 OpenVINO™ 推理引擎,并针对 Intel 硬件(如 CPU/GPU/NPU)进行了优化。

1. 基础推理示例

from qwen_3_asr_helper import OVQwen3ASRModel

# 1. 初始化 OpenVINO 模型

device = "CPU" # 可改为 "GPU"

ov_model = OVQwen3ASRModel.from_pretrained(

model_dir=str(ov_model_dir),

device=device,

max_inference_batch_size=32

)

# 2. 准备音频推理

# 官方示例音频:https://qianwen-res.oss-cn-beijing.aliyuncs.com/Qwen3-ASR-Repo/asr_en.wav

audio_path = "asr_en.wav"

print("🎙️ 正在进行语音识别...")

results = ov_model.transcribe(

audio=audio_path,

language=None # 自动检测语种

)

# 3. 输出结果

print(f"【检测语种】: {results[0].language}")

print(f"【识别文本】: {results[0].text}")

输出示例:

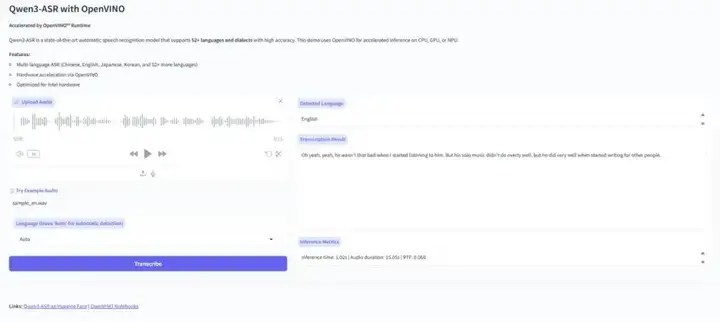

Detected Language: English Transcription: Oh yeah, yeah, he wasn't that bad when I started listening to him. But his solo music didn't do overly well, but he did very well when started writing for other people.

2. 搭建交互式 Demo

借助 OpenVINO™ Notebooks 提供的辅助工具,几行代码即可启动一个支持声音克隆功能的 Web 界面。

from gradio_helper import make_demo

# 创建并启动 Gradio 演示界面

demo = make_demo(ov_model, example_dir=None)

demo.launch()

通过 OpenVINO™ 的原生转换方案,成功地在 Intel 平台上部署了最新的 Qwen3-ASR 模型。这种方式不仅保留了官方模型的完整能力,更通过 OpenVINO™ 的图优化技术大幅提升了 0.6B 和 1.7B 模型的推理效率,为边缘侧的高性能语音应用提供了坚实基础。

点击即可跳转模型合集:

https://modelscope.cn/collections/Qwen/Qwen3-ASR

更多推荐

已为社区贡献983条内容

已为社区贡献983条内容

所有评论(0)