使用AutoDL部署ComfyUI

本文介绍了如何在AutoDL云平台上部署最新版ComfyUI进行AI图像生成。首先选择RTX 3080 Ti机型并安装PyTorch2.8环境,通过SSH连接服务器后克隆ComfyUI仓库并安装依赖。启动服务后使用端口隧道访问Web界面,配置QwenImage模型(包括VAE、TextEncoders、LoRA和扩散模型),通过国内镜像加速下载。最后展示文生图功能的使用方法,包括参数设置和结果查看

·

这里写自定义目录标题

出差在外地,无法使用家里的机器,只能使用 AutoDL 来部署使用AI,我们这次的目的是部署使用最新版本的ComfyUI。

准备机器

我们准备RTX 3080 Ti的机器,选择较新的PyTorch2.8

为了省钱 更换无卡模式

使用FinalShell或者MobaXterm等工具 SSH登录上服务器

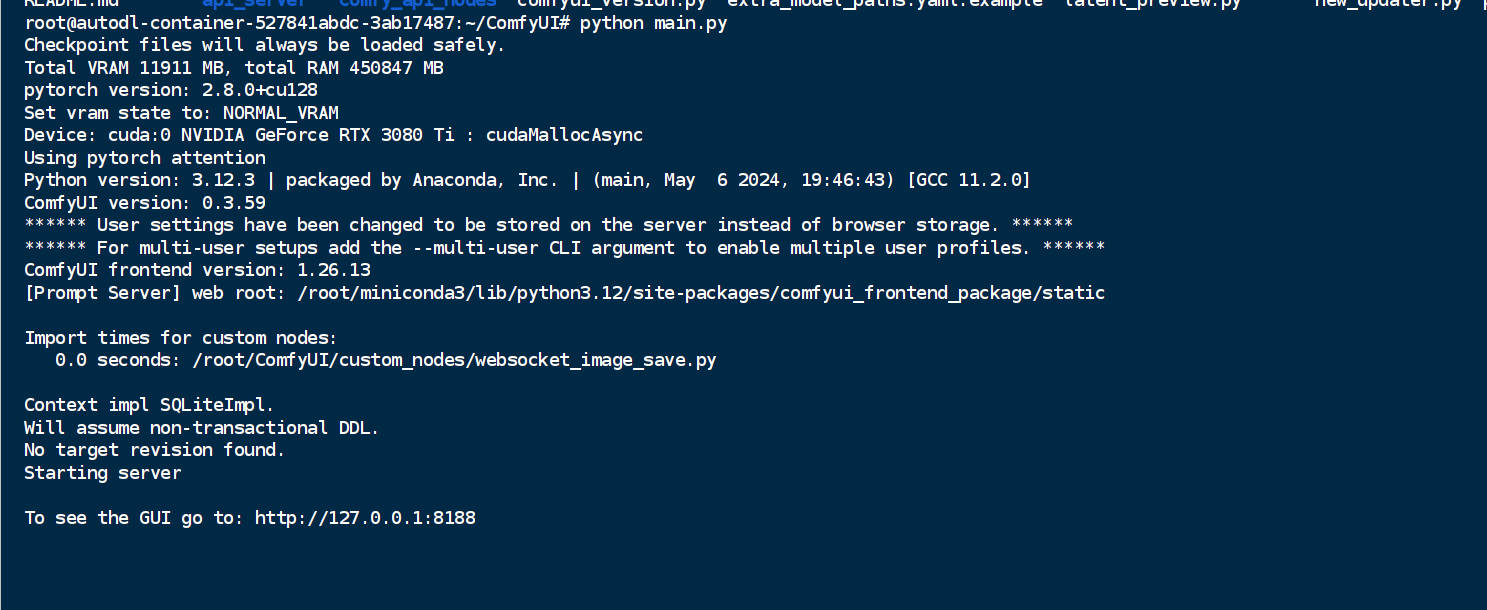

安装ComfyUI

git clone https://github.com/comfyanonymous/ComfyUI.git

cd ComfyUI

pip install -r requirements.txt

python main.py

能看到如下启动结果

说明启动成功

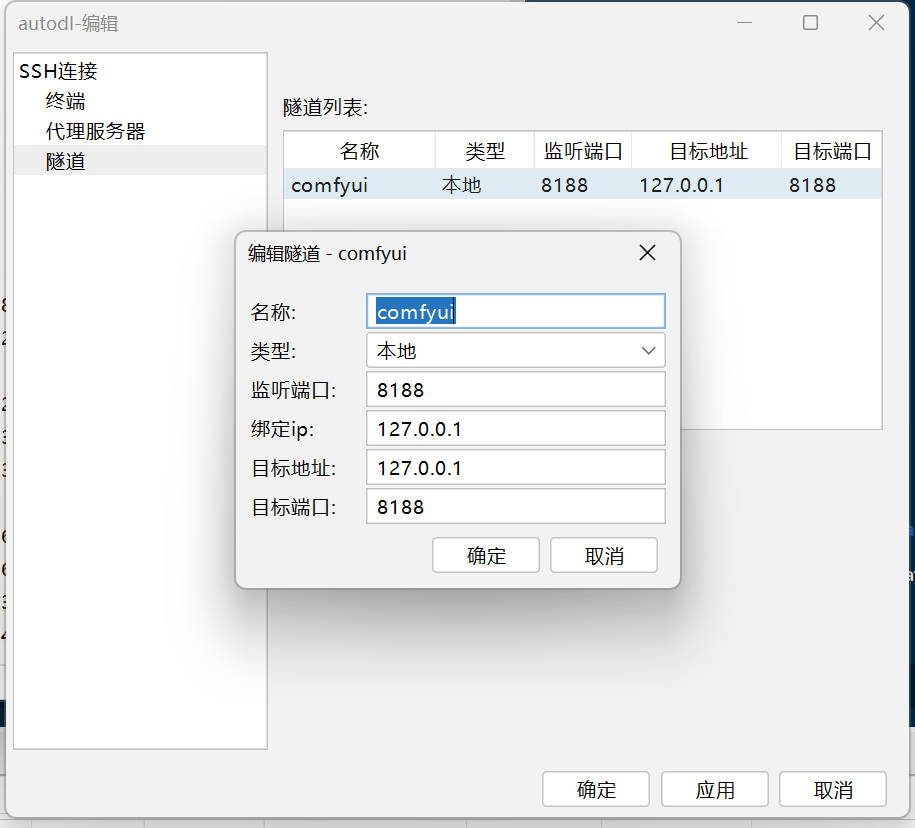

连接服务

除了使用官方工具外,这里推荐使用隧道方法

访问本地 http://localhost:8188 就 可以访问远程的 8188端口

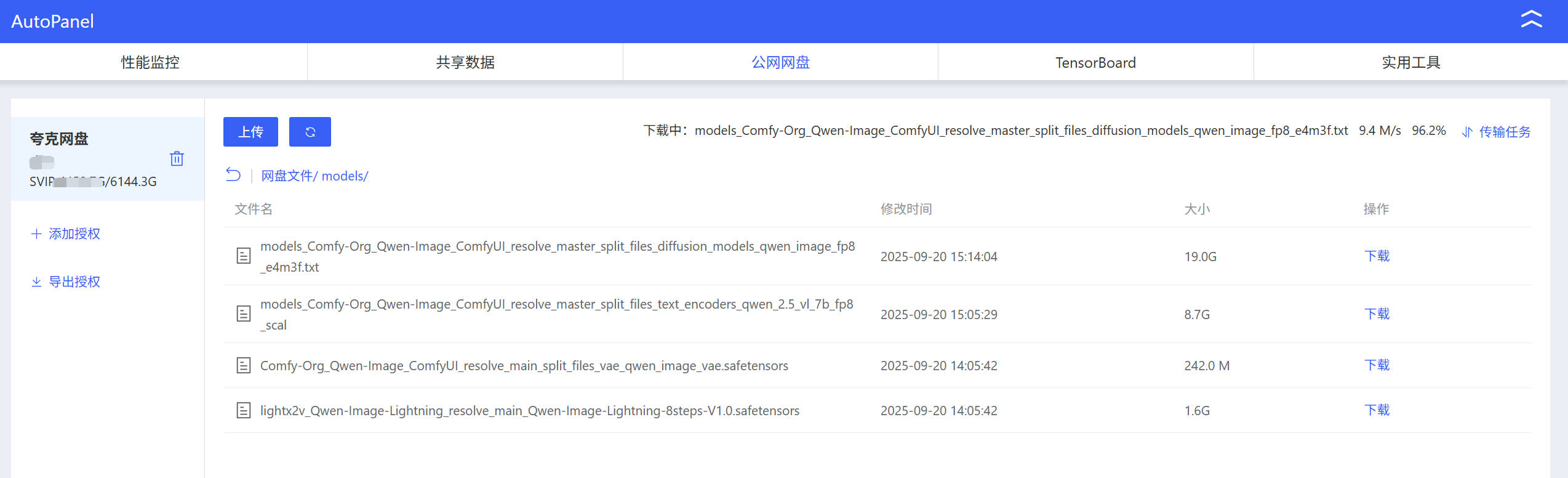

QwenImage模型

一共需要4个模型

我们一共需要上面4个模型,这4个模型,我们可以通过国内的魔塔社区加速下载

我这里选择把模型上传到夸克网盘。然后参考 公网网盘(强烈推荐)下载模型

模型对应放置在对应目录中

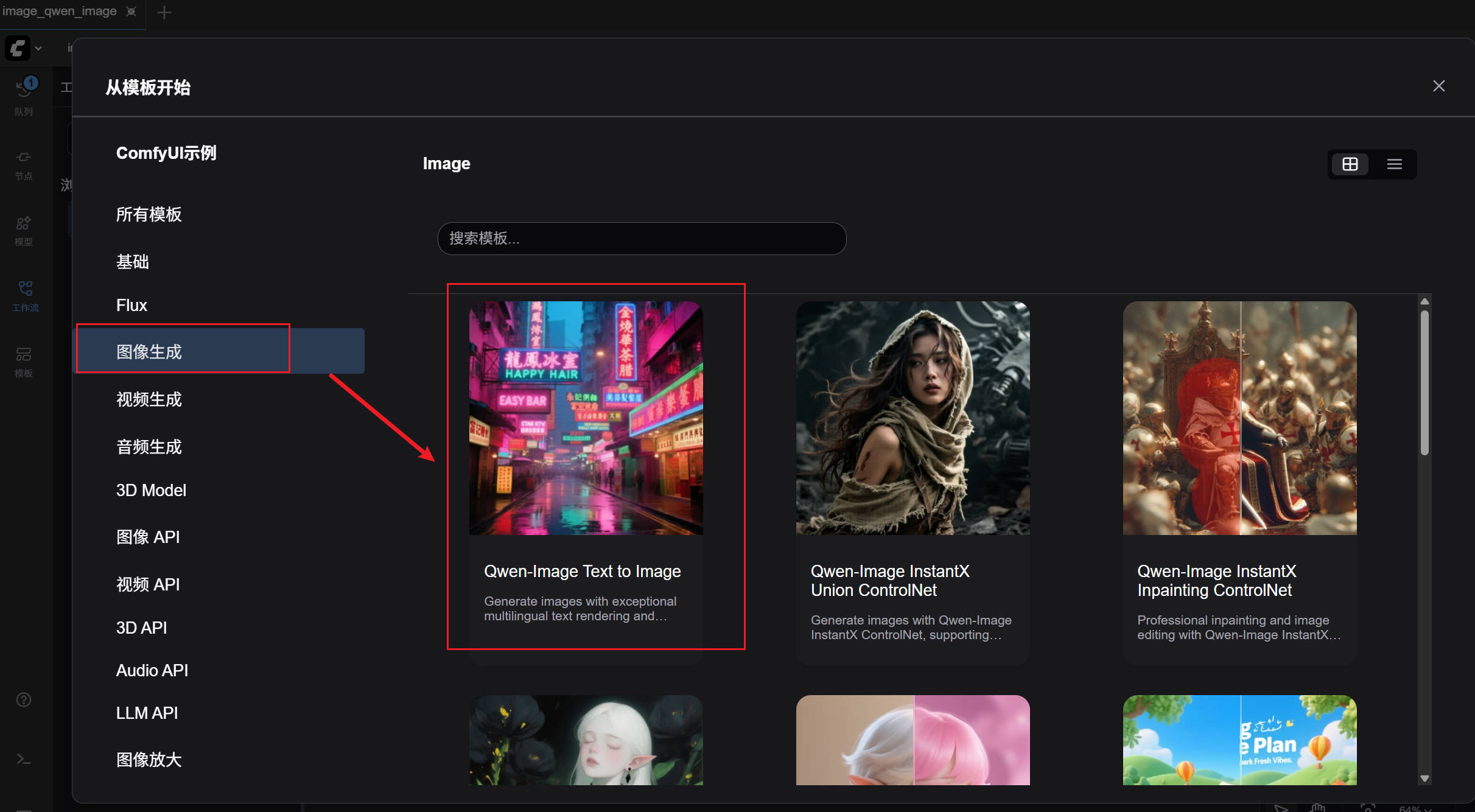

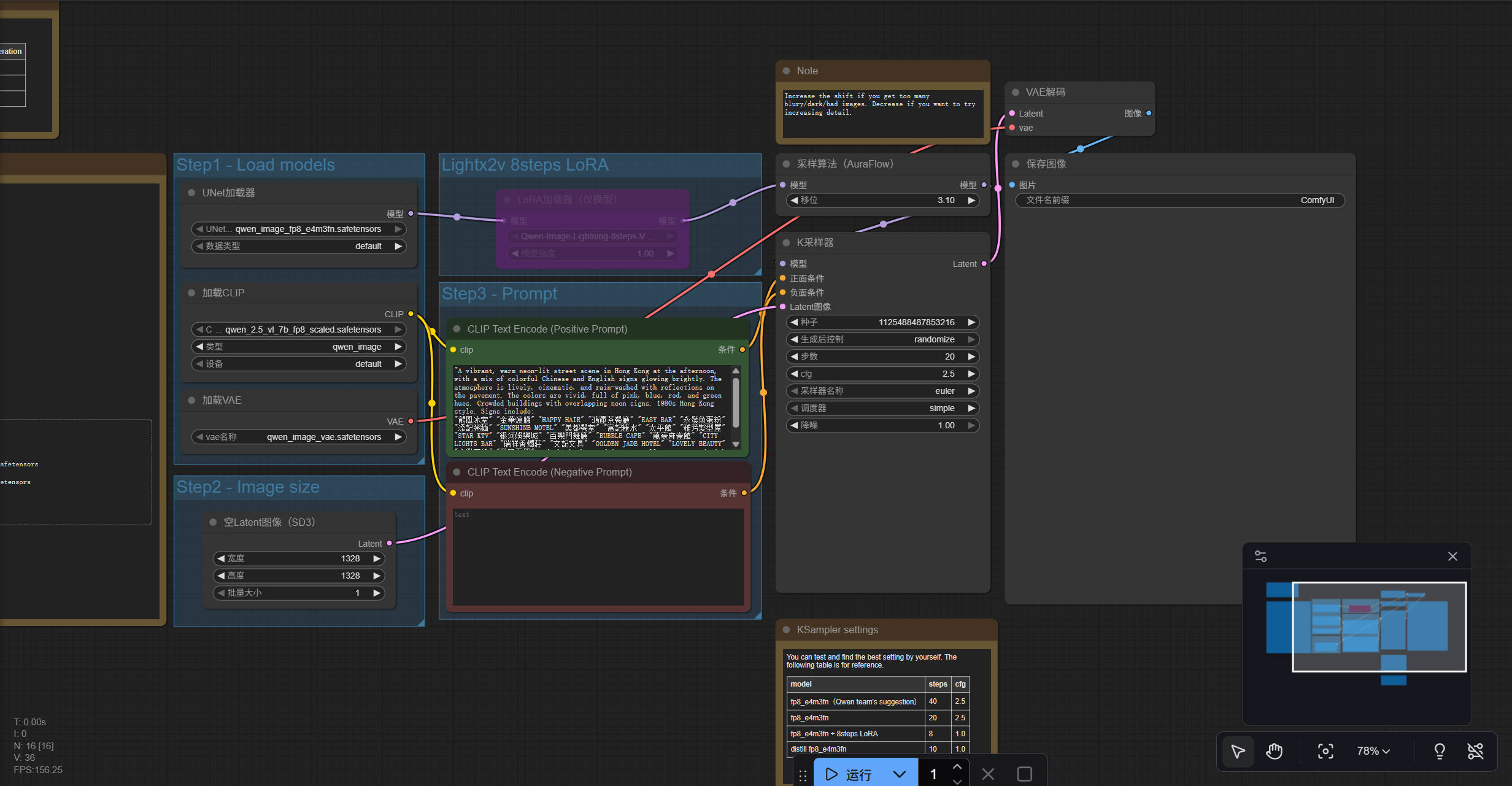

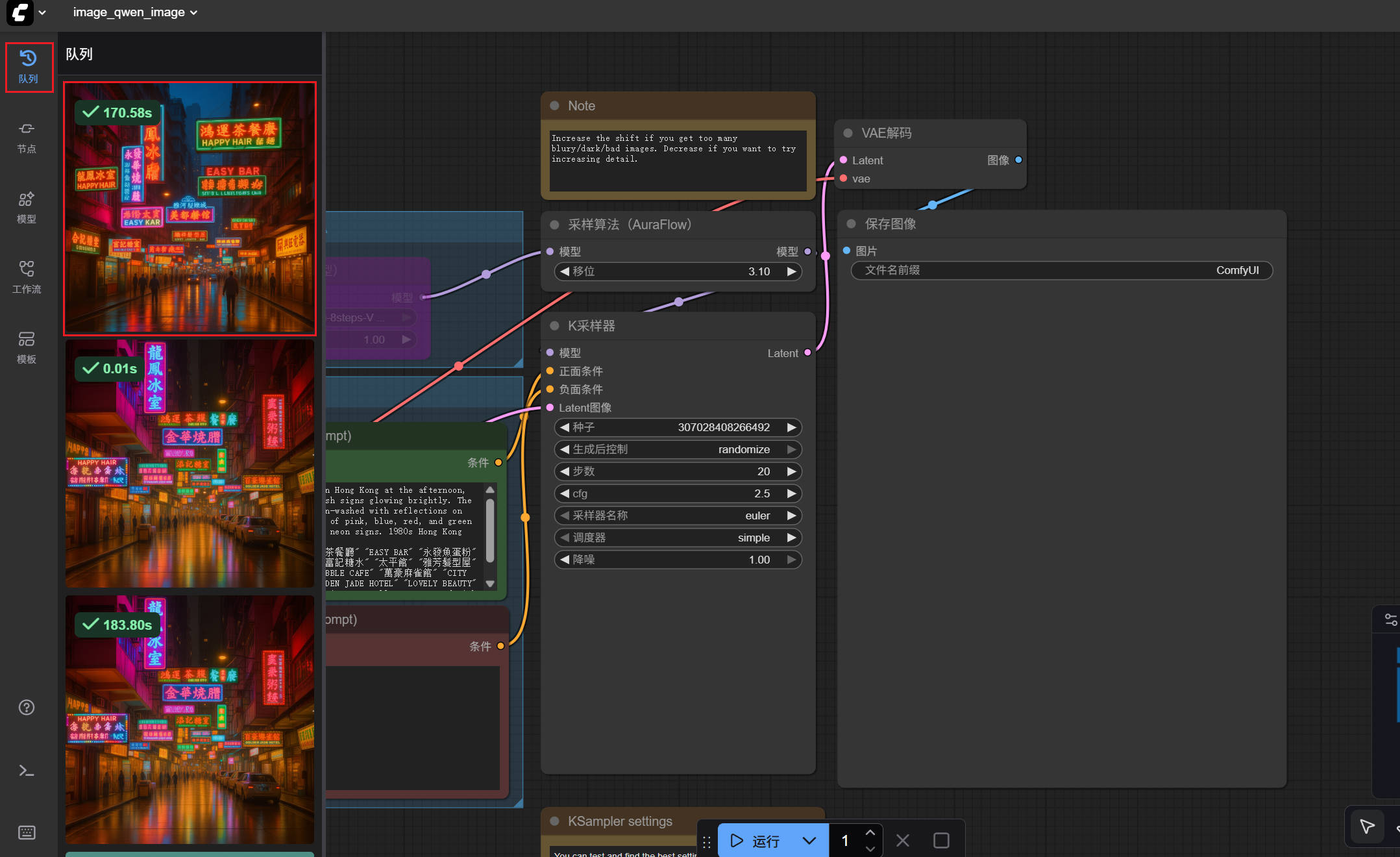

文生图

如果图像保存中没有图片预览,可以在队列中查看。

这是20步的图片

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)